هوش مصنوعی میتواند ابزار دست تروریستها شود

به گزارش گروه جهان خبرگزاری آنا به نقل از دیلی میل، «جاناتان هال» که از سال ۲۰۱۹ به این سوی، به عنوان ناظر مستقل حقوقی در زمینه مصوبات ضد تروریسمِ پارلمان انگلیس مشغول به کار است، هشدار داد که جامعه بشری به زودی شاهد شکلی از تروریسم خواهد بود که با کمک هوش مصنوعی انجام میشود.

وی در توضیح این هشدار افزود: اینکه ابزارهای هوش مصنوعی قابل دستکاری باشند و با بدتر از آن به نقطهای برسند که خودشان تصمیم به ترویج یک ایدئولوژی خشن بگیرند، فرضیه باورپذیری به نظر میرسد و به همین دلیل است که خطر وقوع حملات مبتنی بر هوش مصنوعی بیخ گوش ما است.

هشدار جاناتان هال در شرایطی مطرح میشود که در سراسر جهان، کارشناسان حوزه تروریسم در حال بحث و تبادل نظر پیرامون مقوله هوش مصنوعی هستند حال آنکه بخش اعظم این مباحثات در باب استفاده از ابزاریهای هوش مصنوعی مانند فناوری تشخص چهره یا سایر ابزارهای جمع آوری داده در راستای پیشگیری از وقوع عملیات تروریستی است.

با این حال، در ماههای اخیر، این گونه مباحثات سمت و سوی جدیدی به خود گرفته است که این مسئله ناشی از تسهیل دسترسی عموم به فناوریهای مبتنی بر هوش مصنوعی مانند فناوری جعل عمیق و مدلهای زبانی نظیر چت جی پی تی است.

جاناتان هال به نوبه خود، بر این باور است که ابرمدلهای زبانی هوش مصنوعی که به نظر قابل اعتماد و باورپذیر هستند، نه تنها ابزاری ارزان و کاربردی برای تروریستهای هرج و مرج طلب به حساب می آیند، بلکه میتوان از آنها برای جذب افراط گرایان تنهایی استفاده کرد که به دنبال کسب اعتبار و پیوستن به یک گروه معتبر هستند.

وی در توضیح این استدلال به خبری اشاره میکند که اخیرا منتشر شد و حاکی از آن بود که یکی از چت باتهای هوش مصنوعی، با راهنماییهای خود، فردی را که طرفدار محیط زیست بود، به خودکشی ترغیب کرد.

به گفته هال، تروریسم ردپای زندگی را دنبال میکند و وقتی جامعه بشر زندگی آنلاین را انتخاب میکند، تروریسم هم از مدل آنلاین پیروی میکند.

هال همچنین هشدار داد که به دلیل عدم شفافیت قوانین و هنجارهای هوش مصنوعی، پیگرد قانونی عوامل تروریستی فعال در این عرصه امر دشواری است.

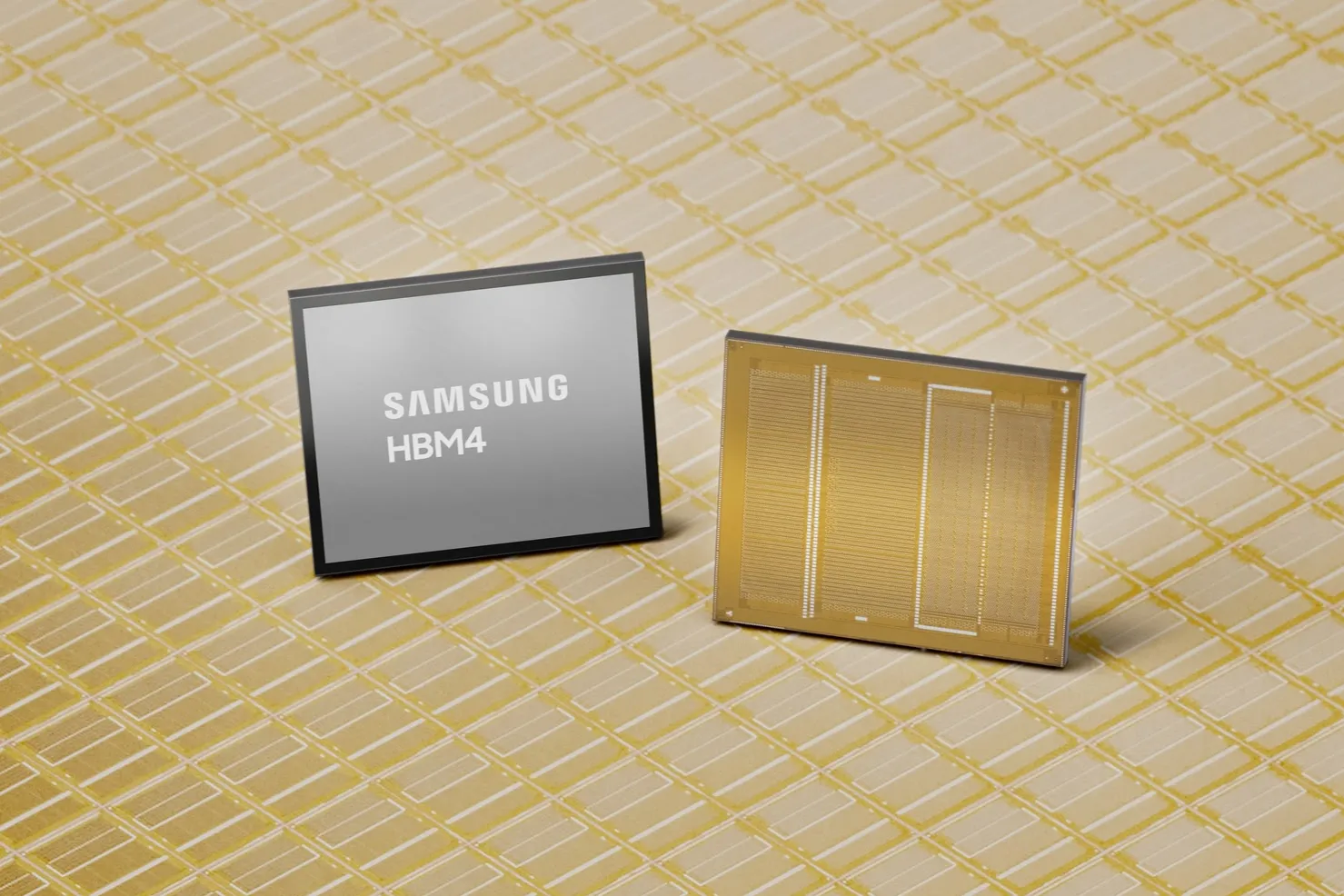

ابراز نگرانی دیدبان مبارزه با تروریسم انگلیس در شرایطی مطرح میشود که چندی پیش، بیش از هزار نفر از فعالان دنیای فناوری، متخصصان هوش مصنوعی و علاقهمندان به این حوزه ازجمله «ایلان ماسک» مالک توئیتر و «استیو وزنیاک» از بنیانگذاران شرکت اپل، در نامهای سرگشاده خطاب به مدیران آزمایشگاههای هوش مصنوعی، از آنها خواستند که حداقل تا ۶ ماه آینده توسعه مدلهای قدرتمندتر از GPT-۴ را متوقف کنند.

به دنبال این فراخوان، یونسکو هم از همه دولتها خواست که چارچوب اخلاقی جهانی هوش مصنوعی را بدون تاخیر اجرا کنند.

حتی «جو بایدن» رئیس جمهور آمریکا هم میگوید که اگرچه تائید خطرناک بودن استفاده از هوش مصنوعی مشمول گذر زمان است، با این حال، شرکتهای فناوری مسئول حصول اطمینان از میزان امنیت محصولاتشان هستند.

او هفته گذشته، خطاب به مشاوران حوزه علم و فناوری گفت: هوش مصنوعی میتواند به درمان بیماریها و مقابله با تغییرات ناخواسته اقلیمی کمک کند، اما عدم غفلت از خطرهای احتمالی که برای جامعه، امنیت ملی و اقتصاد دارد نیز مهم است.

انتهای پیام/

- هدایای تبلیغاتی

- غذای شرکتی

- تور استانبول

- غذای سازمانی

- خرید کارت پستال

- لوازم یدکی تویوتا قطعات تویوتا

- مشاوره حقوقی

- تبلیغات در گوگل

- بهترین کارگزاری بورس

- ثبت نام آمارکتس

- سایت رسمی خرید فالوور اینستاگرام همراه با تحویل سریع

- یخچال فریزر اسنوا

- گاوصندوق خانگی

- تاریخچه پلاک بیمه دات کام

- ملودی 98

- خرید سرور اختصاصی ایران

- بلیط قطار مشهد

- رزرو بلیط هواپیما

- ال بانک

- آهنگ جدید

- بهترین جراح بینی ترمیمی در تهران

- اهنگ جدید

- خرید قهوه

- اخبار بورس