اعتماد به «جی پی تی» کار دست سامسونگ داد

به گزارش گروه جهان خبرگزاری آنا به نقل از انگجت، اغلب به چت جی پی تی (ChatGPT) به عنوان ابزاری نگاه میکنیم که در پیشبرد دامنه وسیعی از کارها مفید است. اما پیشنهاد میکنیم که قبل از آنکه از این چت بات بخواهید که گزارشهای مهم تان را خلاصه یا غلط گیری کند، کمی درباره اعتماد به آن شک کنید چراکه این مدل هوش مصنوعی طوری طراحی شده که آنچه را با آن به اشتراک میگذارید، برای آموزش و ارتقای خود و حتی پاسخگویی به سوال سایر کاربران استفاده خواهد کرد.

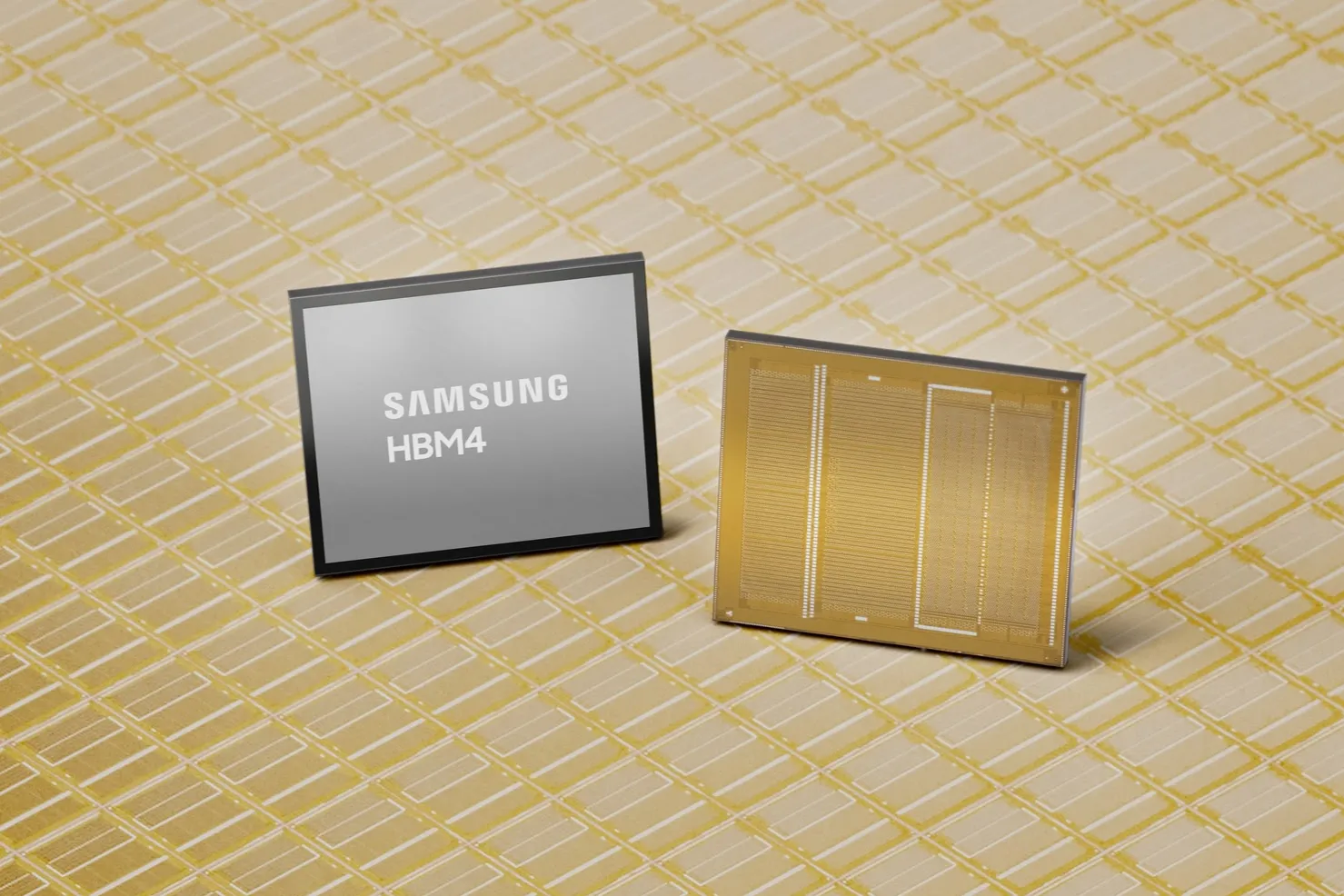

این دقیقا همان تجربه ناخوشایندی است که برای شرکت «سامسونگ» رخ داده است. در واقع، بخش تولید ریزتراشههای سامسونگ به مهندسین خود اجازه داده بود تا برای تسهیل کارشان از چت جی پی تی استفاده کنند غافل از آنکه سه تن از کارکنان، بیش از حد به این ابزار گپ اعتماد کرده و اطلاعات حساس را با آن به اشتراک گذاشته اند.

برای مثال، یکی از کارمندان از جی پی تی خواسته است که کد منبع (سورس کد) دادههای حساس را چک کند، یکی دیگر از جی پی تی درخواست بهینه سازی نرم افزار را کرده بود حال آنکه نفر سوم، محتویات ضبط شده جلسهای محرمانه را در اختیار این ابزار هوشمند قرار داده و خواسته بود که بخشهای مهم آن را یادداشت برداری کند.

شرکت OpenAI به عنوان مالک چت جی پی تی از کاربران خواسته که اطلاعات محرمانه را با این مدل هوشمند به اشتراک نگذراند چراکه این شرکت قادر به حذف آنها از تاریخچه فعالیت شما نیست و تنها راه خلاصی از مشکل این است که اکانت خود را حذف کنید که آن هم نزدیک چهار هفته زمان میبرد.

بعد از هشدارهای متعدد درباره خطرناک بودن اعتماد چشم و گوش بسته به ابزارهای چت مصنوعی ازجمله جی پی تی، تجربه سنگین سامسونگ، دلیل دیگری مبنی بر لزوم به کارگیری احتیاط است.

چندی پیش، بیش از هزار نفر از فعالان دنیای فناوری، متخصصان هوش مصنوعی و علاقهمندان به این حوزه ازجمله «ایلان ماسک» مالک توئیتر و «استیو وزنیاک» از بنیانگذاران شرکت اپل، در نامهای سرگشاده خطاب به مدیران آزمایشگاههای هوش مصنوعی، از آنها خواستند که حداقل تا ۶ ماه آینده توسعه مدلهای قدرتمندتر از GPT-۴ را متوقف کنند.

در بخشی از این نامه میخوانیم: «سیستمهای هوش مصنوعی با هوشمندی قابلرقابت با انسانها میتوانند ریسکهای بزرگی را متوجه جامعه و بشریت کنند».

نگارندگان این نامه باور دارند که این ابزارهای پیشرفته میتوانند تغییر بزرگی را در تاریخ حیات زمین ایجاد کنند و ازاینرو، باید دقیق و با صرف منابع کافی آنها را برنامهریزی و مدیریت کرد.

به دنبال این فراخوان، یونسکو از همه دولتها خواست که چارچوب اخلاقی جهانی هوش مصنوعی را بدون تاخیر اجرا کنند.

حتی «جو بایدن» رئیس جمهور آمریکا هم میگوید که اگرچه تائید خطرناک بودن استفاده از هوش مصنوعی مشمول گذر زمان است، با این حال، شرکتهای فناوری مسئول حصول اطمینان از میزان امنیت محصولاتشان هستند.

او هفته گذشته، خطاب به مشاوران حوزه علم و فناوری گفت: هوش مصنوعی میتواند به درمان بیماریها و مقابله با تغییرات ناخواسته اقلیمی کمک کند، اما عدم غفلت از خطرهای احتمالی که برای جامعه، امنیت ملی و اقتصاد دارد نیز مهم است.

انتهای پیام/

- هدایای تبلیغاتی

- غذای شرکتی

- تور استانبول

- غذای سازمانی

- خرید کارت پستال

- لوازم یدکی تویوتا قطعات تویوتا

- مشاوره حقوقی

- تبلیغات در گوگل

- بهترین کارگزاری بورس

- ثبت نام آمارکتس

- سایت رسمی خرید فالوور اینستاگرام همراه با تحویل سریع

- یخچال فریزر اسنوا

- گاوصندوق خانگی

- تاریخچه پلاک بیمه دات کام

- ملودی 98

- خرید سرور اختصاصی ایران

- بلیط قطار مشهد

- رزرو بلیط هواپیما

- ال بانک

- آهنگ جدید

- بهترین جراح بینی ترمیمی در تهران

- اهنگ جدید

- خرید قهوه

- اخبار بورس