مقابله با شمشیر دولبه هوش مصنوعی/ نخستین قانون جهان چگونه خطرات را کاهش میدهد؟

خبرگزاری علم و فناوری آنا؛ در سراسر جهان، دولتها در حال دست و پنجه نرم کردن با بهترین روش برای مدیریت هوش مصنوعی سرکش هستند.

این فناوری که به سرعت در حال رشد است، وعده میدهد که اقتصاد ملی را تقویت کرده و تکمیل کارهای اداری را آسانتر میکند. اما خطرات جدی مانند جرم و کلاهبرداری مبتنی بر هوش مصنوعی، افزایش انتشار اطلاعات نادرست و دروغ، افزایش نظارت عمومی و تبعیض بیشتر گروههای محروم را نیز در پی دارد.اتحادیه اروپا نقش مهمی در مقابله با این خطرات ایفا کرده است و در هفتههای اخیر، قانون هوش مصنوعی آن به اجرا درآمد.

این نخستین قانون بین المللی است که برای مدیریت همه جانبه خطرات هوش مصنوعی طراحی شده است و سایر کشورها می توانند چیزهای زیادی از آن بیاموزند زیرا آنها نیز سعی می کنند اطمینان حاصل کنند که هوش مصنوعی برای همه ایمن و مفید است.

هوش مصنوعی: شمشیری دو لبه

هوش مصنوعی در حال حاضر در جامعه بشری گسترده شده است. این الگوریتم براساس الگوریتمهایی است که موسیقی، فیلم و برنامههای تلویزیونی را در اپلیکیشنهایی مانند اسپاتیفای یا نتفلیکس توصیه میکند. این دوربینها هستند که افراد را در فرودگاهها و مراکز خرید شناسایی میکنند؛ و به طور فزایندهای در استخدام، آموزش و خدمات بهداشتی مورد استفاده قرار میگیرد.

اما هوش مصنوعی برای اهداف نگران کنندهتر نیز مورد استفاده قرار میگیرد. این فناوری میتواند تصاویر و ویدیوهای دیپ فیک ایجاد کند، کلاهبرداریهای آنلاین را تسهیل کند، به نظارت گسترده دامن بزند و حریم خصوصی و حقوق بشر ما را نقض کند.

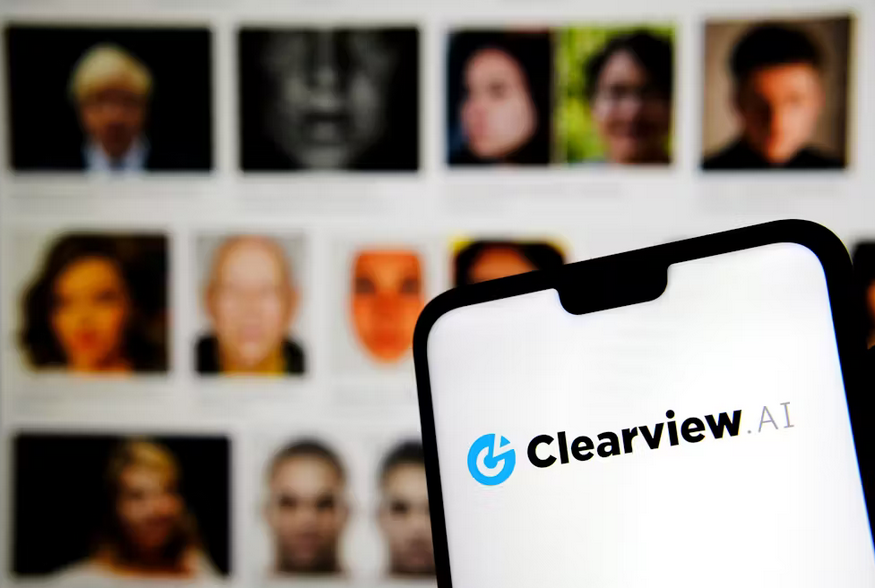

به عنوان مثال، در نوامبر ۲۰۲۱ کمیسر اطلاعات و حریم خصوصی استرالیا، آنجلین فالک، حکم داد که یک ابزار تشخیص چهره به نام «کلرویو ایآی» (Clearview AI) با حذف عکسهای افراد از سایتهای رسانههای اجتماعی برای اهداف آموزشی، قوانین حریم خصوصی را نقض میکند. با این حال، تحقیقات کریکی در اوایل سال جاری نشان داد که این شرکت همچنان در حال جمعآوری عکسهای استرالیاییها برای پایگاهداده هوش مصنوعی خود است.

مواردی از این دست بر نیاز فوری به تنظیم بهتر فناوریهای هوش مصنوعی تاکید میکنند. درواقع، توسعه دهندگان هوش مصنوعی حتی خواستار وضع قوانینی برای کمک به مدیریت خطرات هوش مصنوعی شده اند.

نگاهی به قانون هوش مصنوعی اتحادیه اروپا

قانون جدید هوش مصنوعی اتحادیه اروپا در تاریخ ۱ اوت به اجرا درآمد.

به طور کلی، الزامات سیستمهای هوش مصنوعی مختلف را براساس سطح خطری که ایجاد میکنند، تعیین میکند. هر چه یک سیستم هوش مصنوعی برای سلامتی، ایمنی یا حقوق بشر افراد خطر بیشتری داشته باشد، الزامات قوی تری را باید برآورده کند.

این قانون شامل فهرستی از سیستمهای پرخطر ممنوعه است. این فهرست حاوی سیستمهای هوش مصنوعی است که از تکنیکهای فرعی برای دستکاری تصمیمات فردی استفاده میکنند. همچنین دارای سیستمهای تشخیص چهره نامحدود و واقعی است که توسط مقامات اجرای قانون مورد استفاده قرار میگیرند، مشابه سیستمهایی که در حال حاضر در چین مورد استفاده قرار میگیرند.

سایر سیستمهای هوش مصنوعی، مانند سیستمهای مورد استفاده توسط مقامات دولتی یا در آموزش و مراقبتهای بهداشتی نیز در معرض خطر بالایی قرار دارند. اگرچه این موارد ممنوع نیستند، اما باید بسیاری از الزامات را رعایت کنند.

به عنوان مثال، این سیستمها باید برنامه مدیریت ریسک خود را داشته باشند، براساس دادههای کیفی آموزش ببینند، دقت، استحکام و الزامات امنیت سایبری را برآورده کنند و سطح مشخصی از نظارت انسانی را تضمین کنند.

سیستمهای هوش مصنوعی کم خطرتر، مانند چت باتهای مختلف، تنها باید الزامات شفافیت خاصی را رعایت کنند. به عنوان مثال، باید به افراد گفت که در حال تعامل با یک ربات هوش مصنوعی هستند و نه یک شخص واقعی. تصاویر و متون تولید شده توسط هوش مصنوعی نیز باید حاوی توضیحی باشند که توسط هوش مصنوعی تولید میشوند و نه توسط یک انسان.

مقامات اتحادیه اروپا و ملی تعیین شده نظارت خواهند کرد که آیا سیستمهای هوش مصنوعی مورد استفاده در بازار اتحادیه اروپا این الزامات را رعایت میکنند یا خیر و برای عدم رعایت جریمه صادر خواهند کرد.

نگرانی جهانی برای قانونمند کردن هوش مصنوعی

اتحادیه اروپا در اقدام برای رام کردن انقلاب هوش مصنوعی تنها نیست. اوایل سال جاری میلادی، شورای اروپا که یک سازمان بین المللی حقوق بشر با ۴۶ کشور عضو است، نخستین معاهده بین المللی را به تصویب رساند که براساس آن، هوش مصنوعی باید به حقوق بشر، دموکراسی و حاکمیت قانون احترام بگذارد.

کانادا همچنین در حال بحث درباره لایحه هوش مصنوعی و داده است. این قانون نیز مانند قوانین اتحادیه اروپا، قوانینی را برای سیستمهای هوش مصنوعی مختلف، بسته به خطرات آنها وضع خواهد کرد.

دولت آمریکا اخیرا به جای یک قانون واحد، چند قانون مختلف را پیشنهاد کرده که در بخشهای مختلف به سیستمهای هوش مصنوعی میپردازد.

در استرالیا، مردم عمیقا نگران هوش مصنوعی هستند و گامهایی برای قرار دادن گاردریلهای لازم روی این فناوری جدید برداشته میشود.

سال گذشته، دولت فدرال یک مشاوره عمومی در مورد هوش مصنوعی ایمن و مسئول در استرالیا انجام داد. سپس یک گروه متخصص هوش مصنوعی تاسیس کرد که در حال حاضر روی نخستین قانون پیشنهادی در مورد هوش مصنوعی کار میکند.

دولت همچنین قصد دارد تا قوانین را برای پرداختن به چالشهای هوش مصنوعی در مراقبتهای بهداشتی، حمایت از مصرف کننده و صنایع خلاق اصلاح کند.

رویکرد مبتنی بر ریسک در تنظیم هوش مصنوعی، که توسط اتحادیه اروپا و دیگر کشورها مورد استفاده قرار میگیرد، شروع خوبی در هنگام فکر کردن به چگونگی تنظیم فناوریهای متنوع هوش مصنوعی است.

با این حال، یک قانون واحد در مورد هوش مصنوعی هرگز نخواهد توانست به پیچیدگیهای این فناوری در صنایع خاص بپردازد. به عنوان مثال، استفاده از هوش مصنوعی در مراقبتهای بهداشتی، مسائل اخلاقی و قانونی پیچیدهای را مطرح خواهد کرد که باید در قوانین تخصصی مراقبتهای بهداشتی به آنها پرداخته شود. یک قانون عمومی هوش مصنوعی کافی نخواهد بود.

تنظیم کاربردهای متنوع هوش مصنوعی در بخشهای مختلف کار آسانی نیست و هنوز راه زیادی تا رسیدن به قوانین جامع و قابل اجرا در همه کشورها وجود دارد. سیاست گذاران باید با صنایع و جوامع اطراف استرالیا متحد شوند تا مطمئن شوند که هوش مصنوعی مزایای وعده داده شده را بدون آسیبها - برای جامعه استرالیا به ارمغان میآورد.

انتهای پیام/

- تور استانبول

- غذای سازمانی

- خرید کارت پستال

- لوازم یدکی تویوتا قطعات تویوتا

- مشاوره حقوقی

- تبلیغات در گوگل

- بهترین کارگزاری بورس

- ثبت نام آمارکتس

- سایت رسمی خرید فالوور اینستاگرام همراه با تحویل سریع

- یخچال فریزر اسنوا

- گاوصندوق خانگی

- تاریخچه پلاک بیمه دات کام

- ملودی 98

- خرید سرور اختصاصی ایران

- بلیط قطار مشهد

- رزرو بلیط هواپیما

- ال بانک

- آهنگ جدید

- بهترین جراح بینی ترمیمی در تهران

- اهنگ جدید

- خرید قهوه

- اخبار بورس