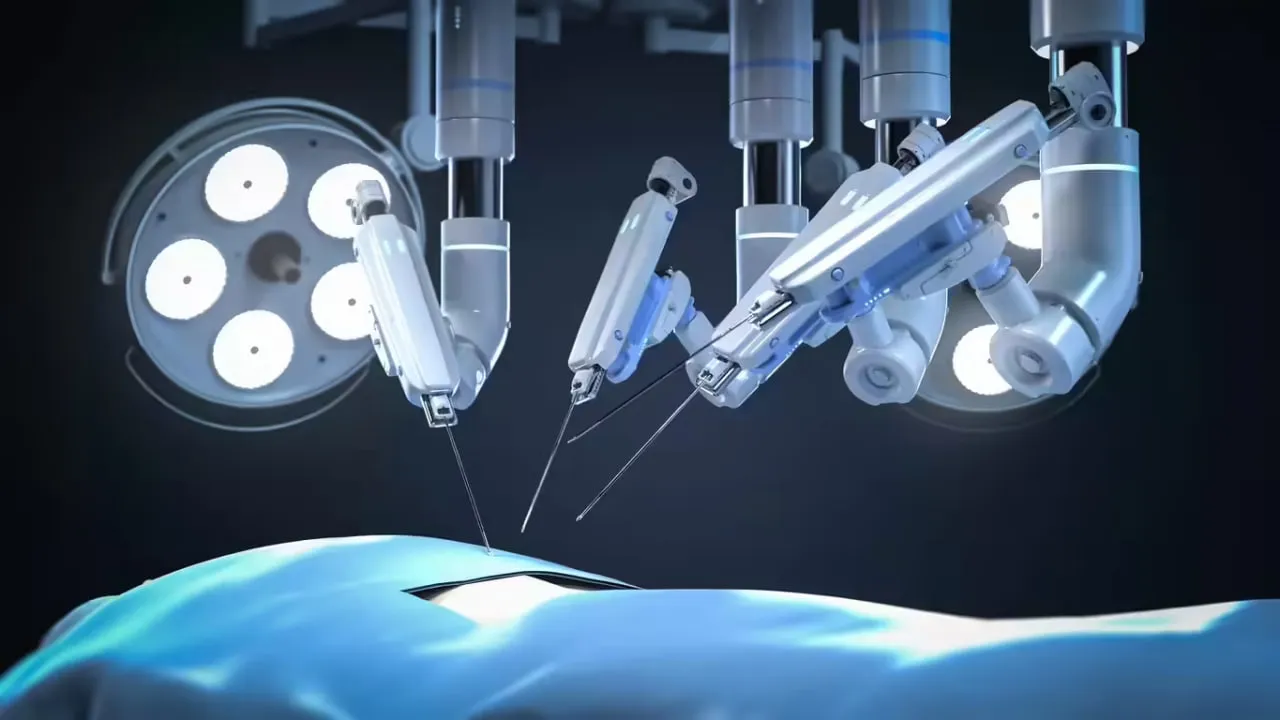

هوش مصنوعی گوگل عضو جدیدی به بدن انسان اضافه کرد

اشتباه مورد بحث به واژه «باسیلار گانگلیا» بازمیگردد که این مدل هوش مصنوعی آن را در تحلیل یک سیتیاسکن مغزی به کار برده است. در ساختار مغز انسان، بخشی به نام «بازال گانگلیا» (هستههای قاعدهای) وجود دارد که مسئول کنترل حرکات و پردازشهای احساسی است؛ در حالی که واژه «باسیلار» به یک شریان حیاتی اشاره دارد که وظیفه خونرسانی به ساقه مغز را بر عهده دارد. ترکیب این دو نام توسط هوش مصنوعی، منجر به خلق یک نام جعلی برای عضوی خیالی شده است که وجود آن در گزارش پزشکی میتواند به رویکردهای درمانی کاملاً متضاد و خطرناک منجر شود.

واکنشهای متفاوت به یک خطای ساختاری

گوگل در واکنش به انتقاد متخصصانی که این خطا را شناسایی کردند، ابتدا بدون اطلاعرسانی عمومی اقدام به اصلاح متن پست وبلاگی خود کرد و پس از اعتراضهای مجدد، اعلام کرد که این مدل واژه اشتباه را از دادههای آموزشی که در آنها اشتباهات نوشتاری رایج بوده، یاد گرفته است. برایان مور، متخصص مغز و اعصاب که اولین بار این موضوع را گزارش کرد، معتقد است که این اتفاق نه یک غلط املایی ساده، بلکه نمونهای بارز از پدیده «توهم» در هوش مصنوعی است.

پزشکان و پژوهشگران حوزه سلامت بر این باورند که خطر اصلی در خودِ اشتباه نهفته نیست، بلکه در «سوگیری خودکارسازی» یا اعتماد ناهوشیار پزشکان به خروجیهای سیستم است. زمانی که یک مدل هوش مصنوعی در اکثر موارد گزارشهای دقیق و با لحنی متقاعدکننده ارائه میدهد، احتمال اینکه پزشک در لحظات خستگی یا فشار کاری زیاد، جزئیاتی مانند تغییر دو حرف در یک واژه تخصصی را نادیده بگیرد، به شدت افزایش مییابد. این موضوع در محیطهای درمانی که تصمیمات بر پایه دادههای متنی اتخاذ میشوند، میتواند منجر به زنجیرهای از تشخیصهای اشتباه شود که در نهایت سلامت بیمار را تهدید میکند.

چالش تکرار خطا در مدلهای پیشرفتهتر

بررسیها نشان میدهد که این قبیل اختلالات تنها محدود به یک مدل خاص نیست و در نسخههای جدیدتر مانند MedGemma نیز مشاهده شده است. آزمایشهای انجام شده در دانشگاه اموری نشان داد که تغییر در نحوه پرسش از هوش مصنوعی میتواند به نتایج کاملاً متفاوتی منجر شود؛ به طوری که سیستم در پاسخ به یک سوال دقیق، عارضه را به درستی تشخیص میدهد، اما با سادهسازی همان سوال، وضعیت بیمار را کاملاً نرمال اعلام میکند.

کارشناسان ارشد اطلاعات پزشکی در بیمارستانهای بزرگ تاکید دارند که هوش مصنوعی در حوزه سلامت باید استانداردی بسیار سختگیرانهتر از انسان داشته باشد. به گفته این متخصصان، اگر قرار باشد هوش مصنوعی همان سطح از خطای انسانی را داشته باشد، ترجیح بر این است که مسئولیت بر عهده پزشک باقی بماند، چرا که فرآیند بازنگری و گفتوگو با یک همکار انسانی درباره یک اشتباه ممکن است، اما مواجهه با خطای یک سیستم خودکار که توضیحی برای منطق اشتباه خود ندارد، بسیار دشوار خواهد بود.

ضرورت ایجاد سیستمهای هشدار توهم

یکی از راهکارهای پیشنهادی برای مدیریت این بحران، استفاده از سیستمهای «هشدار توهم» است که در آن یک مدل هوش مصنوعی بر عملکرد مدل دیگر نظارت میکند تا موارد مشکوک به دادهسازی را شناسایی کند. با این حال، هنوز راه طولانی تا رسیدن به یک فناوری کاملاً قابل اعتماد در تشخیصهای بالینی باقی مانده است. در حال حاضر، بسیاری از مراکز درمانی به جای جایگزینی کامل، به دنبال استفاده از این ابزارها تنها به عنوان کمککننده در کنار نظر نهایی پزشک هستند.

واقعیت این است که هوش مصنوعی پزشکی در حال حاضر در وضعیتی قرار دارد که در آن سرعت توسعه فناوری از سرعت ایجاد چارچوبهای ایمنی پیشی گرفته است. متخصصان هشدار میدهند که پذیرش زودهنگام این ابزارها در مراقبتهای مستقیم بالینی، بدون در نظر گرفتن احتمال خطاهای ساختاری، میتواند تبعات جبرانناپذیری داشته باشد. تا زمانی که این سیستمها نتوانند در مواجهه با ابهامات پزشکی جمله «نمیدانم» را به کار ببرند، نظارت دقیق انسانی و شکاکیت حرفهای پزشکان تنها سد دفاعی در برابر خطاهای فناورانه خواهد بود.

انتهای پیام/

- هدایای تبلیغاتی

- غذای شرکتی

- تور استانبول

- غذای سازمانی

- خرید کارت پستال

- لوازم یدکی تویوتا قطعات تویوتا

- مشاوره حقوقی

- تبلیغات در گوگل

- بهترین کارگزاری بورس

- ثبت نام آمارکتس

- سایت رسمی خرید فالوور اینستاگرام همراه با تحویل سریع

- یخچال فریزر اسنوا

- گاوصندوق خانگی

- تاریخچه پلاک بیمه دات کام

- ملودی 98

- خرید سرور اختصاصی ایران

- بلیط قطار مشهد

- رزرو بلیط هواپیما

- ال بانک

- آهنگ جدید

- بهترین جراح بینی ترمیمی در تهران

- اهنگ جدید

- خرید قهوه

- اخبار بورس